文章作者:Tyan

博客:noahsnail.com | CSDN | 简书

声明:作者翻译论文仅为学习,如有侵权请联系作者删除博文,谢谢!

翻译论文汇总:https://github.com/SnailTyan/deep-learning-papers-translation

摘要

我们提出了SinGAN,一种可以从单张自然图像中学习到的无条件生成模型。我们的模型通过训练可以捕获图像中图像块的内部分布,然后能够生成高质量、多样性的样本,这些样本带有与训练图像相同的视觉内容。SinGAN包含一个全卷积GAN金字塔,每个GAN负责学习不同尺度图像的图像块分布。这可以生成具有任意大小和长宽比的新样本,这些样本具有显著的可变性,同时又保留了训练图像的整体结构和精细纹理。与之前的单图像GAN方案相比,我们的方法不局限于纹理图像,而且非条件的(即它从噪声中生成样本)。用户研究证明,生成的样本通常被混淆为真实图像。我们在各种图像处理任务中说明了SinGAN的实用性。

1. 引言

生成对抗网络(GAN)[19]在建模视觉数据的高维分布方面取得了巨大飞跃。尤其是在特定类别数据集上(例如,面孔[33],卧室[47])训练的非条件GAN,在生成真实、高质量样本方面取得了显著的成功。然而,捕获具有多个对象类别(例如ImageNet[12])的高度多样化数据集分布,仍然是一项重大挑战,并且通常需要另一个输入信号[6]来调整生成或针对特定任务训练模型(例如super-resolution[30],inpainting[41],retargeting[45])。

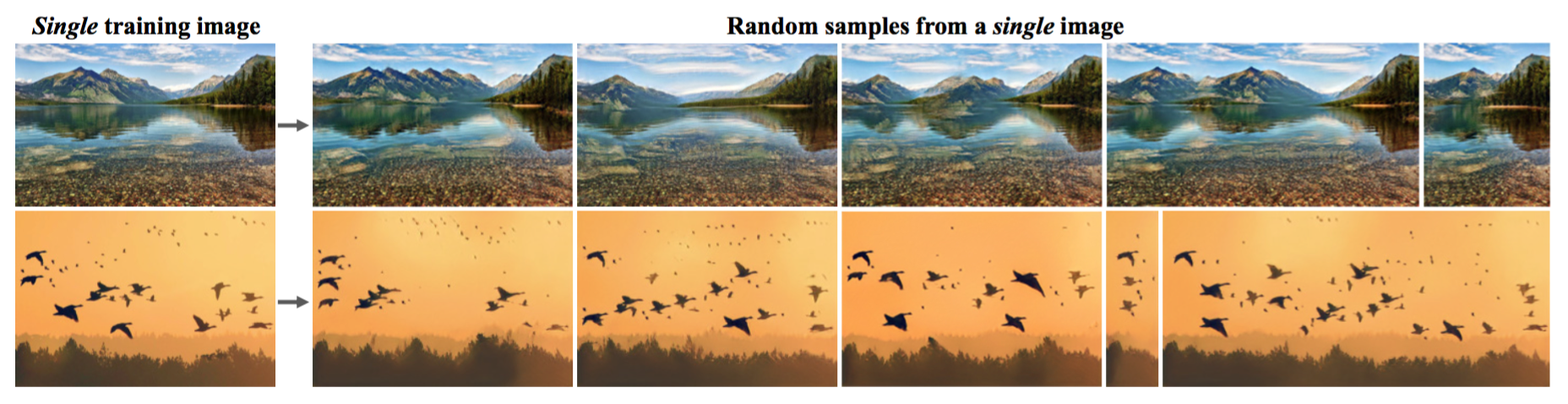

我们利用GAN进入了一个新的领域——从单张自然图像学习的非条件生成。具体而言,我们证明了单张自然图像中图像块的内部统计通常可以携带足够的信息来学习一个强大的生成模型。我们的新单张图像生成模型SinGAN,可以让我们处理包含复杂结构和纹理的一般自然图像,而不需要依赖同类别图像数据集的存在。这是通过全卷积轻量级的GAN金字塔实现的,每个GAN负责捕获不同尺度的图像块分布。训练之后,SinGAN可以生成各种高质量的图像样本(任意尺寸),这些样本在语义上与训练图像类似,但包含新的对象配置和结构(图1)。

图1:从单张训练图像学习到的图像生成。我们提出了SinGAN——一种新的在单张自然图像上训练的非条件生成模型。我们的模型在多个尺度上学习图像的图像块统计,使用专用的多尺度对抗训练方案;它可以用来生成新的真实图像样本,这些样本在保留原始图像块分布的同时创造了新的对象配置和结构。

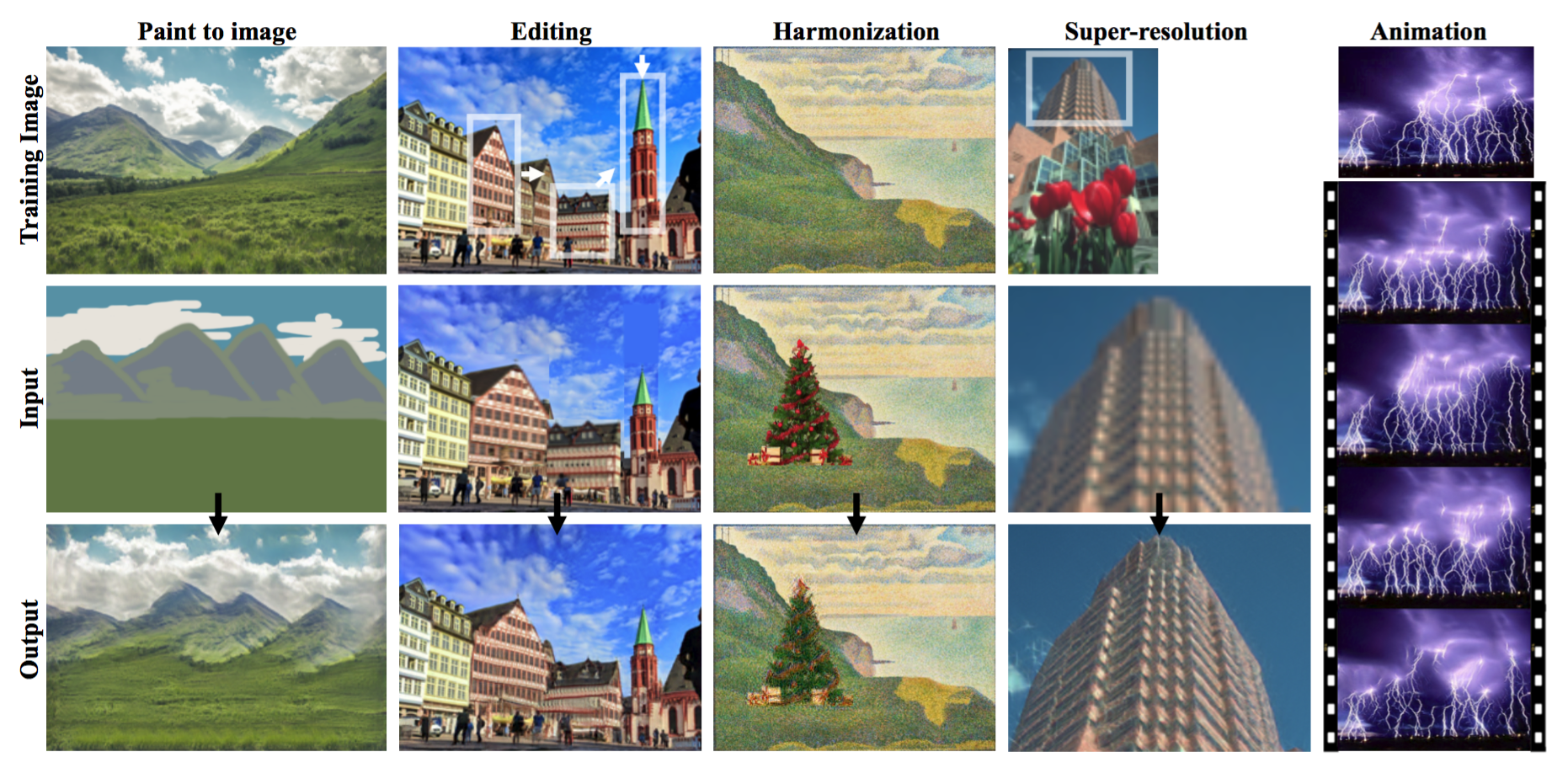

长期以来,建模单张自然图像中图像块的内在分布被看做是许多计算机视觉任务中的有力先验。经典示例包括去噪[65],去模糊[39],超分辨率[18],除雾[2,15]和图像编辑[37,21,9,11,50]。在这些工作中,最密切相关的是[48],其中定义并优化了双向图像块相似性度量,用来确保处理后的图像块与原始图像块相同。受这些工作的激励,这里我们证明了SinGAN可以用在一个简单统一的学习框架内来解决一系列图像处理任务,包括图像的绘制,编辑,协调,超分辨率和从单张图像生成动画。在所有这些任务中,我们的模型都生成了高质量的结果,并保留了训练图像的内在图像块统计(图2和我们的项目网页)。所有的任务都可以通过同一个生成网络实现,而无需任何额外信息或除了原始训练图像外的进一步训练。

图2:图像处理。SinGAN可用于各种图像处理任务,包括:将绘画(剪贴画)转换为真实照片,重新排列和编辑图像中的对象,将新对象协调为图像,图像超分辨率以及从单张图像输入创建动画。在所有这些情况下,我们的模型仅观察训练图像(第一行),并且对于所有应用以相同的方式进行训练,而无需进行架构更改或进一步调整(请参见第4节)。